メッセージングアプリ「Telegram」が、有害コンテンツの取り締まり状況を初めて大々的に報告しました。Telegram創設者兼CEOのパーヴェル・ドゥーロフ氏によると、2024年中に削除したグループとチャンネルの総数は1550万件以上に上り、取り締まりの強化が顕著に表れた形となっています。この報告は、モデレーション体制への批判を払拭し、プラットフォームの透明性を示す目的で行われました。

参考文献

Telegram Moderation Overview

https://telegram.org/moderationAI helps Telegram remove 15 million suspect groups and channels in 2024 | TechCrunch

https://techcrunch.com/2024/12/13/ai-helps-telegram-remove-15-million-suspect-groups-and-channels-in-2024/

取り締まりの背景――ドゥーロフ氏逮捕と批判の高まり

Telegramは、プライバシー保護と匿名性の高さから急速に利用者を拡大してきた一方で、違法コンテンツの温床となる問題が指摘されてきました。2024年8月、ドゥーロフ氏がTelegramを介した麻薬密売・マネーロンダリング・児童ポルノなどの犯罪行為の放置について、共犯容疑で逮捕・起訴されたことがきっかけとなり、同プラットフォームへの監視と批判が一気に高まりました。

Telegramはこれに対応すべく、大規模なコンテンツモデレーション強化を実施し、これまで秘密裏に行われてきた取り締まりの現状を公にすることを決断。公式モデレーション状況ページ「Telegram Moderation Overview」を公開し、ユーザーやメディアに取り締まりの成果と透明性を示す姿勢を打ち出しました。

モデレーションの仕組みと成果――AIと人力の連携

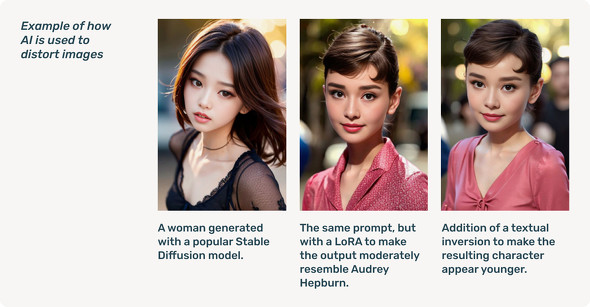

Telegramのモデレーションチームは、有害コンテンツの検出と削除において、ユーザーレポートとAI技術の組み合わせによる効率的な監視体制を構築しています。2024年初頭には最先端のAIモデレーションツールを導入し、1カ月あたり平均約100万件のグループとチャンネルをブロックしてきました。

その結果、2024年中に削除したグループおよびチャンネルの総数は1557万8753件に達し、過去の記録を大幅に更新しています。これにより、Telegram上での違法コンテンツの取り締まりが劇的に強化されたことが明らかになりました。

特に注力したカテゴリー別の取り締まり結果

1. 児童性的虐待資料(CSAM)

Telegramは2018年以降、CSAM(児童性的虐待資料)対策を最優先課題の一つとして取り組んできました。具体的には、過去10年間でモデレーターによってブロックされたCSAMのハッシュデータベースを活用し、共有される画像を自動的に照合するシステムを導入しています。

2024年には、Internet Watch Foundation(IWF)などの専門組織と連携してデータベースの拡張を実施。その結果、同年中に70万7576件のCSAM関連グループとチャンネルをブロックすることに成功しました。

2. テロリズムおよび暴力関連コンテンツ

テロリズムや暴力の扇動に関するコンテンツもTelegramが強化している分野です。2022年以降、Global Center for Combating Extremist Ideologyなどの組織と提携し、テロ関連コンテンツの監視を徹底化。

2024年には、暴力や過激主義を拡散するグループやコミュニティ13万119件をブロックしたと報告しています。これは、Telegramが暴力的思想の拡散を防ぐためのプロアクティブな対策が進展していることを示しています。

3. 麻薬取引や違法商品の販売

Telegramは、麻薬や武器、偽造品などの違法商品の取引が行われているグループやチャンネルも積極的に取り締まっています。AIによるパターン認識とユーザーレポートの組み合わせで、日々数万件の違反コンテンツがブロックされていると報告されています。

批判への対応と今後の展望

これまでTelegramは、有害コンテンツ対策についての情報をほとんど公開してこなかったため、メディアやユーザーの間では「十分な対策が取られていない」との批判が根強く存在していました。しかし今回、具体的な数値やモデレーション手法を公表することで、批判の払拭と信頼回復を目指す動きが見られます。

パーヴェル・ドゥーロフ氏は「有害コンテンツとの戦いは継続的な努力が必要だ」と述べており、今後もAI技術の活用や外部組織との提携を通じて監視体制を強化する方針を示しています。

Telegramが2024年に削除したグループとチャンネルの総数1557万件以上という成果は、プラットフォーム全体の安全性を大幅に向上させたことを示しています。特にCSAMやテロリズム関連コンテンツの取り締まりは大きな進展を見せており、AI技術と人力モデレーションの組み合わせが有効であることが証明されました。

しかし、有害コンテンツは日々進化し、巧妙化しています。Telegramが今後も安全なコミュニケーションプラットフォームとしての地位を確立するには、さらなる技術革新と透明性の向上が不可欠です。

コメント